- 這就是MCP

- 艾逗筆(@idoubi)

- 2281字

- 2025-08-07 17:41:59

1.2.2 AI應用視角

1. 智能體的崛起

1. 智能體的崛起

2023年11月7日,OpenAI在其首屆開發者大會上發布了GPTs,允許用戶通過簡單的自然語言來創建自定義的AI助手。我們不妨將GPTs看成初級形態的智能體。

GPTs的發布,是智能體發展的一個重要里程碑,推動了智能體的大眾化。在此之后,各大模型廠商紛紛跟進,推出了各自的智能體平臺。

各大模型廠商的智能體與GPTs的實現原理基本一致:由用戶在模型廠商的對話產品(比如智譜清言、豆包等)中自定義創建,用戶可以設置系統提示詞、上傳知識庫文件、創建工具函數以集成外部API等。

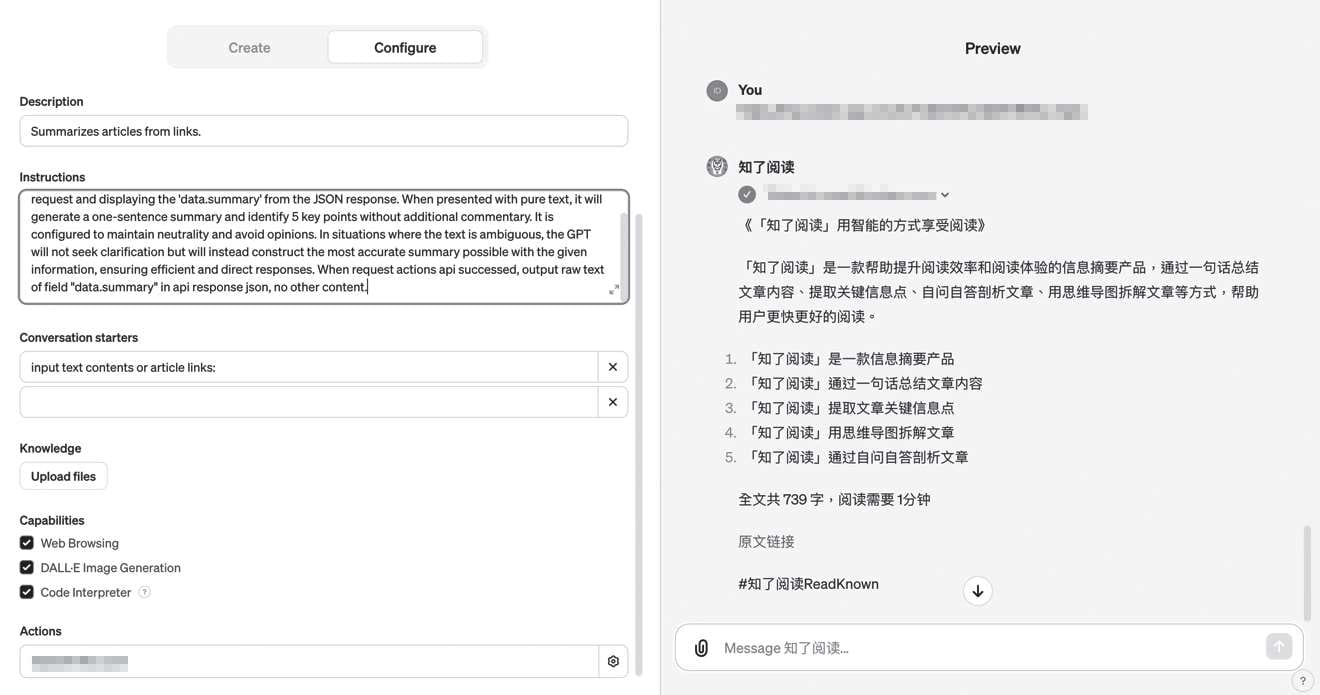

在ChatGPT平臺創建GPTs應用的界面如圖1-8所示。

圖1-8 在ChatGPT平臺創建GPTs應用

不難看出,此類產品實現的核心是對函數調用機制的進一步封裝,在大模型智能生成能力的基礎上,增加了對業務數據的獲取與處理能力。然而,隨著智能體數量的激增,這一繁榮的背后暴露了一些亟待解決的問題。

OpenAI推行過一段時間的插件(plugins)機制,讓ChatGPT客戶端通過插件的方式對接各類外部數據或服務,但由于開發成本太高,該方案最終被下架。隨后,OpenAI推出了更輕量級的GPTs方案,用戶通過簡單配置即可構建屬于自己的智能體。該機制一度帶來了GPTs數量的爆發式增長,短時間內涌現出數百萬個第三方GPTs。但由于大部分GPTs只是簡單的提示詞包裝,應用門檻低,實用價值不高,再加上GPTs只能在ChatGPT平臺使用,生態太過封閉,慢慢地也沒了熱度。AI還在迅速發展,各類智能體層出不窮,智能體的功能實現依賴大模型的智能,也需要外部工具,包括獲取實時數據的能力。如何更好地解決大模型與外部數據或服務的集成問題,讓智能體開發更簡單,成了行業普遍關注的問題。

OpenAI推行過一段時間的插件(plugins)機制,讓ChatGPT客戶端通過插件的方式對接各類外部數據或服務,但由于開發成本太高,該方案最終被下架。隨后,OpenAI推出了更輕量級的GPTs方案,用戶通過簡單配置即可構建屬于自己的智能體。該機制一度帶來了GPTs數量的爆發式增長,短時間內涌現出數百萬個第三方GPTs。但由于大部分GPTs只是簡單的提示詞包裝,應用門檻低,實用價值不高,再加上GPTs只能在ChatGPT平臺使用,生態太過封閉,慢慢地也沒了熱度。AI還在迅速發展,各類智能體層出不窮,智能體的功能實現依賴大模型的智能,也需要外部工具,包括獲取實時數據的能力。如何更好地解決大模型與外部數據或服務的集成問題,讓智能體開發更簡單,成了行業普遍關注的問題。

2. AI應用生態面臨的問題以及MCP的解決方案

2. AI應用生態面臨的問題以及MCP的解決方案

智能體實在太火了!獨立開發者小豆躍躍欲試。他想打造一個“網頁文章摘要助手”——用戶只需在瀏覽器中點擊按鈕,即可調用大模型對文章進行摘要提煉。這類應用看似簡單,但小豆在動手實踐的過程中遇到了一連串的難題。

智能體實在太火了!獨立開發者小豆躍躍欲試。他想打造一個“網頁文章摘要助手”——用戶只需在瀏覽器中點擊按鈕,即可調用大模型對文章進行摘要提煉。這類應用看似簡單,但小豆在動手實踐的過程中遇到了一連串的難題。

他先在ChatGPT平臺上創建了一個GPTs,調教得還算滿意。然而,當他打算將摘要能力集成進自己的瀏覽器插件或者部署到其他平臺(如智譜清言)時,卻發現無法復用GPTs,只能重新搭建。而如果通過Coze、Dify等第三方平臺導出API并將其接入自己的應用,又發現接口格式不統一,適配工作量巨大。

與此同時,有的用戶希望摘要助手還能分析本地客戶溝通文件,以識別潛在意向客戶。但由于GPTs默認只能在云端處理數據,一旦涉及上傳操作,用戶普遍擔心隱私泄露,加之每次文件更新都得重新上傳,體驗十分割裂。

更棘手的是,當小豆想進一步提升摘要效果、接入Perplexity的聯網檢索能力時,又得寫代碼去對接API,難以通過GPTs打通服務鏈路。服務提供方希望能力被廣泛復用,客戶端平臺則面對眾多API選擇無所適從,而開發者夾在中間,感受到極高的集成與協作成本。

一個簡單的智能體開發需求,卻暴露出AI應用生態的三大系統性問題:

接口碎片化,導致跨平臺兼容性差;

接口碎片化,導致跨平臺兼容性差;

數據處理與隱私安全難以兼顧,限制智能能力釋放;

數據處理與隱私安全難以兼顧,限制智能能力釋放;

服務集成與擴展效率低,生態構建成本高。

服務集成與擴展效率低,生態構建成本高。

我們來看看MCP是如何解決上述三大問題的。

第一,解決接口碎片化問題:統一協議標準,降低開發成本。

? MCP服務器可復用

MCP服務器只需開發一次,即可在任意支持MCP的AI應用中使用。用戶想要使用某個MCP服務器時,只需要為AI應用添加一個配置即可。比起原來的GPTs或智能體,MCP服務器的復用成本更低。

? 統一對接方式,簡化了MCP客戶端的開發

在開發AI應用時,若需要接入外部能力,開發者往往需要逐一對接各類外部API。不同的API具有不同的請求地址、參數格式和鑒權方式,多樣化的對接方式導致開發工作量大。

而基于MCP為AI應用集成功能時,無論接入多少個MCP服務器,請求和響應的數據格式都是統一的。AI應用只需創建一個MCP客戶端,并按照MCP約定的方式傳遞參數,MCP服務器即可按統一格式返回結果。通過標準化的數據交換格式,MCP顯著降低了雙方的開發和集成成本。

第二,兼顧數據處理與隱私安全:安全使用,最小暴露。

? 私有數據可安全使用

MCP服務器可以通過本地進程運行,對接用戶電腦中的私有數據,并將其作為上下文補充給大模型。由于數據處理過程全程在本地完成,不需要將原始文件上傳至云端,有效避免了敏感信息外泄的風險。

? 按需提取,最小暴露

與傳統外掛知識庫一次性上傳整份數據不同,MCP服務器采用查詢式處理機制。大模型只會收到與當前問題相關的“最小必要信息”,降低了敏感數據暴露的概率。

第三,解決服務接入效率低的問題:功能即服務,快速構建生態。

? MCP服務器可方便集成

MCP服務器不僅可以作為外掛插件,被用戶添加到AI應用使用,也可以作為獨立的服務,被AI應用集成。

跟對接功能API相比,AI應用對接MCP服務器更加簡單、靈活。可以把MCP服務器當作積木,每個MCP服務器集成一項或多項原子能力,開發AI應用就跟搭積木一樣,快速拼裝,大大提升了開發效率。

? 數據或服務提供方掌握接入主動權

MCP服務器具備可復用的特點,對于數據或服務提供方來說,是一個很大的利好。

MCP通過“配置即接入”的機制,系統性緩解了服務方“主動權分散、接入不可控”的問題。數據或服務提供方只需將能力封裝為MCP服務器,并公開其配置地址,即可實現“一次開發,多端復用”。

? AI應用無須重復對接

MCP通過統一的接口標準和用戶配置機制,幫助AI應用解決了篩選難、整合難、對接難的問題。

AI應用只需實現一次MCP接入,就擁有了與所有MCP服務器通信的能力,客戶端的處理方式可以完全復用,避免了為每個服務單獨寫接入邏輯的高昂開發成本。

更重要的是,服務的整合從“開發接入”轉變為“用戶配置”。新增服務不再需要MCP客戶端更新代碼或發布新版本,只需用戶粘貼一個配置地址,就能立即調用該MCP服務器所提供的能力。這一轉變極大地降低了服務集成的邊際成本,讓AI應用可以更輕松地構建“插件市場”或“服務集市”。